Le industrie aerospaziale, automobilistica e medica stanno abbandonando i tradizionali metodi di contatto basati sullo stilo per controllare i loro processi e l’esecuzione del controllo di qualità dimensionale sui loro prodotti, e stanno invece scegliendo di utilizzare tecniche di misurazione ottica 3D senza contatto. Diversi sistemi di misurazione funzionano meglio con diversi tipi di materiali e in un documento intitolato ” Misurazioni di forme multi-materiale per materiali additivi potenziate dall’intelligenza artificiale “, un gruppo di ricercatori ha utilizzato un approccio di intelligenza artificiale per “riconoscere il materiale di un oggetto misurato e per fondere le misure prese da tre tecniche di misurazione di forme ottiche per migliorare le prestazioni del sistema rispetto all’utilizzo individuale di ciascuna tecnica. ”

La misurazione ottica senza contatto ha diversi vantaggi: non è distruttiva, ha una maggiore velocità, aumenta l’area di acquisizione per ciclo di misurazione e riduce i costi.

La misurazione ottica senza contatto ha diversi vantaggi: non è distruttiva, ha una maggiore velocità, aumenta l’area di acquisizione per ciclo di misurazione e riduce i costi.

“Per le tecniche basate su fotocamere ottiche senza contatto, in particolare, la capacità di sfruttare i vantaggi degli algoritmi di riconoscimento delle immagini basati su intelligenza artificiale per migliorare ulteriormente la misurazione offre un ulteriore vantaggio rispetto alle tecniche di contatto basate sullo stilo”, affermano i ricercatori. “Le tecniche ottiche senza contatto, tuttavia, non sono una panacea e, per alcuni scenari di misurazione, devono ancora essere utilizzate le tecniche basate sullo stilo, poiché le tecniche ottiche presentano una minore precisione, sensibilità dei materiali e requisiti molto più elevati per la gestione e l’archiviazione dei dati “.

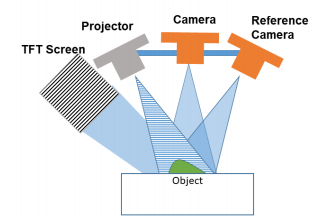

Nello studio, i ricercatori hanno eseguito la funzione dei dati utilizzando una fotocamera di riferimento comune per utilizzare tre diverse tecniche di misurazione basate sulla fotocamera:

Proiezione di frange: una tecnica di luce strutturata che utilizza un proiettore e una fotocamera per creare una nuvola di punti 3D di una scena osservata da una telecamera mediante triangolazione o gradino di fase. È usato principalmente per misurare oggetti che riflettono diffusamente.

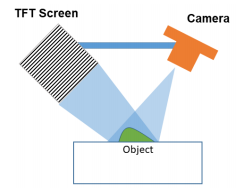

Deflettometria: una tecnica di luce strutturata simile alla proiezione della frangia, ma invece di proiettare lo schema della frangia, viene visualizzata su uno schermo TFT. Funziona meglio per oggetti riflettenti, poiché un fascio di raggi da ciascun pixel rifletterà dall’oggetto nella fotocamera tramite la riflessione diretta.

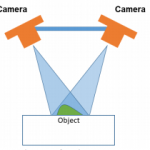

Fotogrammetria: una tecnica che crea una nuvola di punti 3D sfruttando le caratteristiche di superficie uniche che esistono in due o più immagini dell’oggetto prese da diversi punti di vista. Vengono utilizzate più viste di telecamere per ricostruire la superficie 3D di un oggetto cercando le corrispondenze di pixel nelle immagini scattate.

La combinazione delle tre tecniche consente di creare nuvole di punti di superficie 3D per oggetti riflettenti e diffusi che sono privi di caratteristiche o hanno più funzioni sulla loro superficie. Per combinare i dati di tutte e tre le tecniche, i ricercatori hanno utilizzato la stessa telecamera di riferimento per tutti e tre i sistemi e uno schema di raccolta dati spazio-temporale per raccogliere dati da diverse parti dell’immagine in momenti diversi. Lo schema di raccolta aveva due parti: una strategia di segmentazione dell’immagine e una strategia di sincronizzazione temporale.

La strategia di segmentazione dell’immagine impiegava un apprendimento approfondito attraverso una rete di segmentazione o SegNet ed è stata addestrata per identificare diversi materiali in un’immagine della scena presa dalla videocamera di riferimento. Lo schema di sincronizzazione temporale ha ciclato tutti e tre i sottosistemi di misura nel dominio del tempo attivando i moduli richiesti utilizzati da ciascuna tecnica al momento opportuno e prendendo le misure della scena.

“Dato che tutte e tre le nuvole di punti sono prese dalla stessa telecamera di riferimento, vengono posizionate automaticamente nello stesso frame di riferimento”, affermano i ricercatori. “I dati 3D parziali possono, quindi, essere automaticamente fusi insieme per formare una nuvola di punti 3D ottimizzata della scena contenente tutti e tre gli oggetti. Questa strategia di sincronizzazione temporale consente sia la fusione dei dati ottimizzata, la minimizzazione dei dati di misurazione e la riduzione del rumore, poiché ogni tecnica di misurazione funziona meglio per un materiale specifico. ”

Alcune sfide si sono verificate durante la strategia di segmentazione dell’immagine, principalmente in relazione a riflessioni spurie e cambiamenti di luce ambientale.

“In particolare, i riflessi di altri oggetti, i riflessi delle sorgenti di luce ambientale e il cambiamento significativo nell’illuminazione creano errori nella segmentazione delle immagini etichettando erroneamente una grande proporzione di pixel”, spiegano i ricercatori. “Il lavoro futuro includerà il controllo dell’illuminazione e dei riflessi usati durante la creazione delle immagini schermando i campioni dall’illuminazione ambientale e addestrando la rete includendo più condizioni di illuminazione per migliorare la robustezza e infine personalizzare la selezione dei parametri di rete per consentire una maggiore precisione segmentazione delle immagini. ”

Gli autori del documento includono P. Stavroulakis, O. Davies, G. Tzimiropoulos e RK Leach.